3,736 읽음

[AI & 감정③] “기술 발전만큼 윤리 기준도 따라야”…사회적 책임 강조

투데이신문

투데이신문 2

2이 같은 흐름 속에서 국제인공지능윤리협회와 NC문화재단은 지난 2월 26일 ‘감정교류 AI의 올바른 개발과 활용’을 주제로 ‘모두의 인공지능 윤리 컨퍼런스’를 개최했다. 이날 박형빈 서울교육대학교 교수, 차유진 KAIST 교수, 박미애 경북대학교 교수가 감정교류 AI의 사회적 영향과 제도적 과제를 짚고 기업·사용자·정부의 역할을 제시했다. 투데이신문은 세 전문가의 발표를 중심으로 감정교류 AI를 둘러싼 쟁점과 해법을 짚어본다.

이용 시간도 늘어나는 추세다. 와이즈앱 분석(2025년 7월)에 따르면 감정교류 전문 앱 ‘제타’의 1인당 평균 사용 시간은 17.2시간으로 챗GPT(2.32시간)보다 크게 높았다. 특히 10대·20대에서 아바타 기반 채팅 AI 앱에 대한 집중 사용이 확인되면서 젊은 세대의 감정교류 AI 의존이 심화되는 양상이 포착됐다.

시장 성장 속도 역시 가파르다. 감정교류 AI 시장은 2024년 29억 달러 규모에서 2034년까지 연평균 21.7% 성장할 것으로 전망되며, 음성 기반 감정 AI 또한 22% 이상의 성장률이 예측된다.

이처럼 AI가 업무 생산성을 넘어 인간의 감정 영역까지 침투하면서 기술 발전 속도에 걸맞은 안전장치와 책임 구조를 갖춰야 한다는 목소리가 나온다. 이에 국제인공지능윤리협회(IAAE)는 지난해 9월 27일 전문가와 개발사 등과 함께 국내 최초로 ‘감정교류 AI 윤리 가이드라인’을 발간해 주목을 받았다.

박미애 경북대학교 인공지능혁신융합대학사업단 계약교수(국제인공지능윤리협회 부회장)는 지난 2월 26일 열린 ‘모두의 인공지능 윤리 컨퍼런스’에서 “급변하는 환경에서 감정교류 AI 가이드라인 수립은 필수가 아니라 필연”이라며 “기술 확산 속도에 맞춰 책임 있는 활용 기준을 마련해 나가야 한다”고 말했다.

박 교수는 “AI와 정서적으로 상호작용하는 순간 사용자는 AI를 준(準)인격적 존재로 받아들일 수 있다”며 “이는 인간에게 느끼는 감정과 다르지 않을 수 있다”고 설명했다. 이어 “AI는 감정을 ‘표현’할 수는 있어도 실제로 ‘경험’하지는 못한다”며 “그럼에도 사용자가 이를 실제 감정으로 인식할 경우 자율성 침해나 의존성 심화로 이어질 수 있다”고 지적했다.

이에 따라 가이드라인은 △정서 존중 반응 설계 △심리적 상처 최소화 △취약 계층 보호 △AI의 비인격성 고지 △자율성 보장 및 사전 동의 등 5대 핵심 가치를 제시하고 있다. 또한 미성년자와 취약 계층에 대해서는 감정 설계 범위를 엄격히 제한하는 한편 비전문성 고지 의무화의 필요성도 분명히 했다.

박 교수는 “가이드라인은 개발사를 위한 문서에 그치지 않는다”며 “사용자도 어떤 기준으로 설계돼야 하는지 알고 이용 과정에서 스스로를 보호할 수 있어야 한다는 데 목적이 있다”고 설명했다. 정책기관에 대해서는 “이용자 보호를 위한 기준이자 정책 논의의 출발점으로 참고할 수 있다”고 덧붙였다.

이런 가운데 ‘AI 에이전트’의 등장은 새로운 위험 요소로 지목됐다. 박 교수는 “사용자의 직접 지시 없이도 외부 앱과 연동해 문자 발송이나 결제와 같은 자율적 행동을 수행하는 구조가 확산되고 있다”며 “감정교류 기능과 결합할 경우 위험의 차원이 근본적으로 달라질 수 있다”고 경고했다.

박 교수는 “국내에서는 올해 1월부터 인공지능 기본법이 시행됐고, 해외에서도 동반자 챗봇 규제법 시행 등 AI 규제가 본격화되면서 가이드라인 발간 이후 불과 6개월 만에 환경이 급변했다”며 “이러한 변화는 가이드라인의 개정과 보완 필요성을 뒷받침한다”고 강조했다.

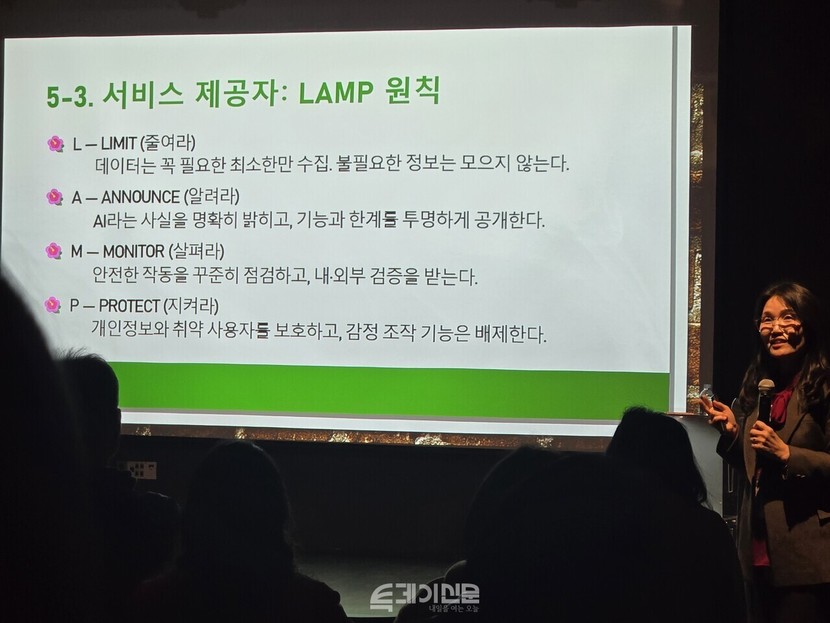

이어 “가이드라인은 살아있는 규범으로, 변화 속도에 맞춰 지속적으로 업데이트되고 강화돼야 한다”며 “기업은 책임 있는 혁신을, 사용자는 주체적 활용을, 정부는 합리적 정책 수립을 수행할 때 비로소 인간 중심의 AI 기술 발전이 가능하다”고 강조했다.