1,321 읽음

AI기반 ‘알고리즘 전쟁’의 메커니즘과 제언

BEMIL 군사세계

BEMIL 군사세계 0

0박상우 육군 대위 / 국방부,

강인욱 육군 대위 / 서울대학교 전기정보공학부 박사과정

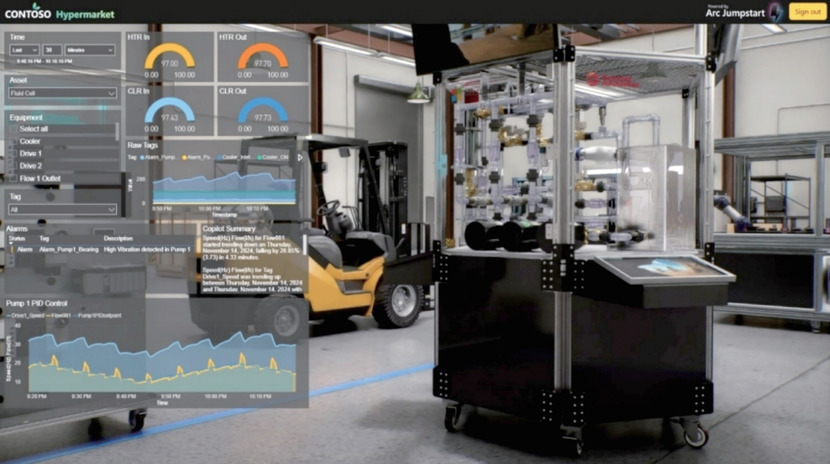

’25년 12월, 미 전쟁부(DoW)가 구글 제미나이의 정부기관 전용 모델인 ‘GenAI.mil’을 도입하였다. AI를 활용한 심층연구, 문서작성, 영상 및 이미지 분석 등에 활용할 것으로 발표하였다. 이를 통해 정보분석, 군수지원, 데이터 수집 등 전쟁부 업무 효율성 향상에 크게 기여할 것으로 예상된다.

미 전쟁부의 사례와 같이 군사분야에서의 AI 활용은 단순한 행정 효율화를 넘어선 사건이다. 자율적 프로그래밍은 인간의 최소 개입으로 의사결정과 행동을 수행하는 것을 목표로 할 것이고, AI는 전장의 방대한 데이터를 처리하는 보조 도구를 넘어, 자율적인 의사결정과 행동을 수행하는 가상 지휘관(Virtual Commander)의 등장을 불러일으킬 것이다.

우리는 이미 딥마인드의 알파고(AlphaGo)와 이세돌의 대국에서 AI의 승리를 목격했다. 하지만 우리는 알파고의 승리에 가려진 중요한 전조를 놓쳤다. 당시 바둑 해설자들은 알파고의 수를 보며 ‘실수’나 ‘이해할 수 없는 수’라고 평가했다.

그러나 결과적으로 그 수들은 승리를 결정짓는 신의 한 수였다. 인간이 AI의 수를 이해하지 못한 이유는 명확하다. 알파고는 인간이 수천 년간 쌓아온 기보를 암기한 것뿐만 아니라(이세돌과 대국한 알파고 리), 천문학적인 자체 학습 과정을 통해 승률을 극대화하는 새로운 로직을 창조(알파고 제로)했기 때문이다.

향후 제미나이(Gemini)와 같은 거대 AI 모델이 전술 수립에 투입될 때도 마찬가지다. 지휘관은 AI가 제안하는 전술이 왜 효과적인지 인지적으로 따라가지 못할 것이며, 여기서 인간의 직관과 기계의 확률 사이의 거대한 균열이 발생할 것으로 보인다.

본 고는 단순히 AI가 지휘관의 결심을 보좌하며 OODA 루프를 단축시키고, 전쟁의 속도를 증폭시키는 데에 주목하지 않는다. AI는 인간이 이해할 수 없을 전투양상인 알고리즘 전쟁을 만들어 낼 것이고, AI가 우리를 이해시키는 것이 아니라, 우리가 AI를 이해해야 함을 주장할 것이다.

AI의 학습 방법론

AI가 인간의 상식을 뛰어넘는 전술을 도출하는 배경에는 고도의 학습 알고리즘이 자리잡고 있다.

먼저 AI 하면 가장 많이 듣는 딥러닝(Deep Learning)과 데이터 추론이다. AI는 수십만 건의 과거 교전 기록, 위성 이미지, 지형 정보, 기상 데이터 등 비정형 데이터를 실시간으로 학습할 수 있다. 인간 지휘관이 수 개의 변수를 고려하고, 이를 보조하기 위한 체크리스트를 활용할 때, AI는 수백만 개의 파라미터를 동시에 연산하여 데이터 노드 간의 활성화 함수(Activation Function)를 알아내고, 이런 결과물을 토대로 인간이 알기 어려운 비선형적 상관관계를 찾아낸다. 이를 통해 데이터 속에 숨겨진 승리의 패턴을 추론해낸다.

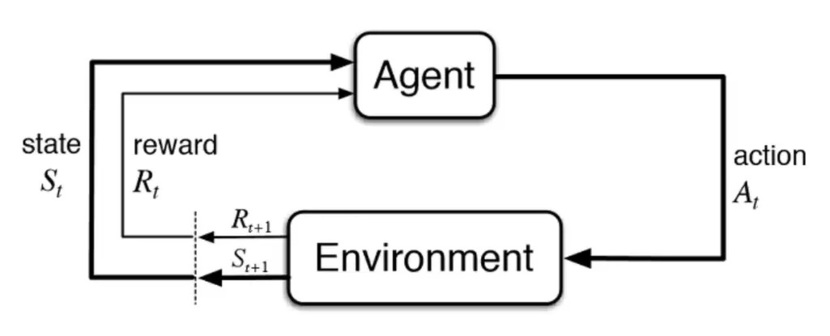

또한, AI는 학습과정 중 자신이 선택한 행동 중 긍정적인 것은 강화하고, 부정적인 것은 줄이기 위해 인간이 보상/처벌을 받는 것과 유사한 강화학습(RL : ReinforcementLearning)을 사용한다. 강화학습에서 AI는 가상 시뮬레이션 환경에서 수억 번의 전투를 치르며, 승리라는 보상(Reward)을 얻기 위해 최적의 행동을 찾아낸다.

딥마인드는 2015년 DQN(Deep Q-Network)을 통해 강화학습의 가장 기초적인 장을 열었다. 학습을 수행하는 에이전트는 특정 상태(S, State)에서 어떤 행동(A, Action)을 취했을 때 얻을 보상의 기댓값인 Q함수를 신경망으로 근사한다. 이 수식으로 AI가 당장의 보상(R, Reward)뿐만 아니라 미래의 가치까지 계산한다. 이는 알파고가 초반에 손해를 보더라도 후반 승기를 잡는 이상한 수를 두는 원천이 된다.

이후 강화학습은 눈부신 발전을 거친다. 간단한 연구사례를 소개하자면, PPO(Proximal Policy Optimization)를 통해 학습 시 정책이 너무 급격하게 변하지 않도록 제약(Clipping)을 걸어 학습 수렴을 안정화하고, SAC(Soft Actor-Critic) 방식을 통해 보상뿐만 아니라 행동의 다양성(Entropy)에도 점수를 준다. 이를 통해 AI는 인간이 생각하지 못한 기괴하고 창의적인 전술을 더 적극적으로 탐색하게 된다.

AI 모델 아키텍처 중 시퀀스와 관계성을 파악하는 데 유용하고, 가장 유명한 구조 중 하나인 Transformer를 활용한 Decision Transformer(DT)도 빼놓을 수 없다. 전통적인 강화학습이 보상을 최대화하는 정책(Policy)이나 가치 함수(Value Function)를 학습하는 데 초점을 맞췄다면, Decision Transformer는 GPT와 같은 언어 모델이 다음 단어를 예측하듯, 강화학습 문제를 입력 정보(시퀀스)에 조건을 부여하여 어떤 내용에 집중할지 압축하는 ‘조건부 시퀀스 모델링’ 문제로 재정의하여 접근한다. DT는 이 방식을 통해 긴 문맥을 파악하는 능력이 탁월하고, 안정적인 학습 특성을 가진 게 가장 큰 특징이다.

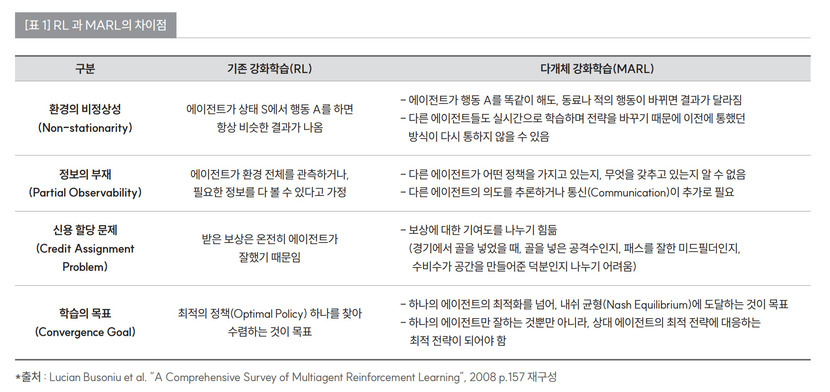

앞서 기술한 강화학습은 하나의 개체에만 해당하는 사항이고 전투는 복수의 전투원이 활동하며 승리를 이끌어 내야 하는 상황이기 때문에, 여기서는 다개체 강화학습(MARL : Multi-Agent Reinforcement Learning)을 도입하게 된다. [표 1] 에서 보이듯 MARL은 기존 RL과 크게 네 가지 방면에 있어서 차이가 있다.

AI가 싸우는 법

AI를 전투에 도입하는 것에 있어서 논란은 끊이지 않고 있다.

비판론자들의 주장은 “생사가 걸린 문제는 너무 중요하니까 AI에게 맡기면 안 된다”라는 게 주 골자다. 하지만 미국의 대표적인 방산 스타트업인 안두릴의 CEO 팔머 럭키는 “생사가 걸린 문제는 너무 중요하니까 오히려 최고의 기술(AI)을 써야 한다”라고 반론한다. 민간인 배와 군함을 구별하지 못하는 미사일보다는 AI가 판단하여 정확히 타격하는 것이 부수적 피해를 줄이는 길이라는 결론이다.

위와 같은 논쟁은 AI가 우리의 목전 앞에 와있다는 걸 방증해준다. AI와 특정 과업에 국한되지 않고 인간과 같이 일반적인 지능을 가진 AGI(Artificial General Intelligence), 인간을 넘어서는 ASI(Artificail Super Intelligence)의 발전은 하루가 멀다하고 이뤄지고 있으며, 우리가 막연하게나마 그려왔던 미래가 나날이 가까워지고 있다. 그렇다면 AI가 가져올 전투에서의 미래는 어떤 것일까? 필자는 인간이 여태까지 쌓아온 전사(戰史)와 AI가 학습한 전투의 간극은 클 것이며, 이로 인해 여러 혼란이 있을 것으로 보고 있다.

그렇다면 AI는 전투를 어떻게 지휘할까? 결론적으로, AI는 편제와 계획수립 자체를 없앨 것이다.

우선, AI는 인간이 이해하기 힘든 계획을 만들어 낼 것이다. 알파고에서 해설자가 이해할 수 없는 수를 두면서 이겼다. 스타크래프트에서 인간 게이머가 하지 않는 방식인 일꾼을 본진에 엄청 배치시키거나, 병력을 완전히 분산시키는 등의 방법을 통해 승리를 따냈다. AI의 물리적 능력(손빠르기, 맵 보기)을 하향 조정하였음에도 승리한 결과이기에 더욱 의미가 깊다. 이는 AI가 애초에 인간과 비교했을 때 완전히 다르게 사고하기 때문이다.

인간은 복잡한 상황을 빠르게 판단하기 위해 관습이나 쌓아온 경험에 의존한다. 하지만 AI는 전통이나 상식이 없다. AI는 인간이 검토조차 하지 않고 버린 수만 가지의 경우의 수까지 계산해 조금이라도 승률을 높이는 것을 선택한다. 또한, 인간이 “지형이 험하니 매복하자”는 식의 인과관계에 기반한다면, AI는 인간의 눈에는 전혀 상관없어 보이는 변수들을 조합한다. 적군의 통신주기, 습도, 연막탄 투하가 승률을 더 높인다는 식의 직관적이지 않은 최적화를 보일 수 있다. 이는 인간 지휘관이 “왜 거기서 연막탄을?”이라며 의문을 가질 만한 것들이 전술로 나타날 수 있음을 의미한다.

계획수립 과정에서 전통적인 군은 ISR 자산 배치 → 데이터 취득 → 정보판단 → 작전 구상 및 계획수립 → 워게임 검증이라는 긴 단계를 거친다. 또한, 여러 상황을 대비하고, 불확실성을 메우기 위해 수많은 우발계획과 보조계획을 문서화한다. 상황이나 필요에 의해 일부 과정은 생략될 수 있지만, 순차적으로 누적된다. 반면 AI는 이러한 선형적 단계를 거치지않는다. AI는 탐지자산, 지형 및 기상정보, 우군 부대의 데이터와 원하는 수준의 최종상태가 입력되는 순간 수조 번의 시뮬레이션을 바탕으로 사전 학습된 작전수행 방안이 도출된다.

이 방식은 기존의 작전명령이라는 결과물에 도출하는 선형적 과정이 아니라, 최종상태라는 목표값과 현재 상태의 오차를 줄이는 방향으로 역설계한다. 참모의 조언이나, 지휘관의 작전지침, 임무 내용은 모두 파라미터 값으로 녹아든다. 또한 AI는 우발계획을 따로 작성하지 않는다. 상황이 변하면 그 즉시 파라미터를 재수렴시켜 실시간으로 새로운 경로를 생성하기 때문이다. 그렇기 때문에 알고리즘 전쟁에서 전투의 진행은 계획 문서나 예상이 아닌 흐르는 데이터의 기류 속에서의 연속적인 대응 과정이 된다.

알고리즘 전쟁에서 클라우제비츠가 이야기한 군사적 천재가 나타날 수 있다고 보인다. 클라우제비츠는 군사적 천재가 불확실성과 우연의 지배자, 전장의 안개를 뚫고 진실을 포착하는 직관적 통찰력인 ‘Coup d'oeil’을 가지고 있다고 하였다. 과거에는 이것이 소수 영웅이 지닌 자질이나 훈련의 결과로 비롯된 영역이었으나, AI는 군사적 천재의 자질을 데이터 기반의 추론으로 재정의할 수 있다.

또한, 알고리즘 전쟁에서는 편제가 없을 것으로 예상된다. 기존의 계획수립도 작전환경에 맞게 전투력 분배를 하지만, AI는 이걸 더 쪼개버릴 것이다. 전통적인 전투에서 인간 지휘관은 부대 단위를 움직인다. 그렇기 때문에 전투력을 개인이 아닌 부대 단위로 나온다고 간주한다. 이는 집단은 개인보다 강하다는 신념도 있겠지만, 지휘관의 인지적 한계로 인한 불가피한 타협의 과정일 수 있다. 인간은 수천 명의 병사를 일일이 통제할 수 없기에 그들을 부대로 묶어 단순화하여 명령을 내리는 것이 가장 효율적이다. 즉, 기존의 편제는 전술적 최적화의 결과가 아니라 인간의 뇌가 전쟁의 복잡성을 감당하기 위해 만든 편의라는 것이다.

반면, AI에게 통제 범위의 한계는 훨씬 적다. 알고리즘 전쟁에서 전장의 수천 개 전투원, 장비를 뭉뚱그려진 부대가 아닌 독립된 파라미터를 가진 개별 노드로 인식할 수 있다. 이는 수백 명의 병사와 수천 대의 드론을 각각 독립된 개체로 인지하고 제어한다. 목표 확보 작전 시 AI는 수천 개의 유닛이 초단위로 각각 임무를 부여받아 적의 급소를 타격하는 전술을 구사한다. 이는 인간 지휘관이 조율할 수 있는 ‘협동’의 범위를 완전히 벗어난, 수학적 동기화에 가깝다.

또한, 다개체 강화학습을 기반으로 기존의 교육훈련 방식과 동일하게 학습 시에는 중앙화된 구조로 집중적으로 훈련하고, 시행 시에는 중앙 통제와의 연결이 끊어진 상태로 진행시킬 수 있다. 이때, 각 에이전트는 파라미터 안에 내재된 팀워크를 토대로 작전을 수행한다. AI의 지시가 단절되거나 없는 상황이더라도, 각 개체는 학습한 결과를 토대로 작전을 수행할 수 있다. 이는 우리가 흔히 이야기하는 과업을 주지 않고, 의도를 주어 작전을 수행케 하는 ‘임무형 지휘’를 다개체 강화학습을 토대로 기술적으로 적용시킬 수 있음을 보여준다.

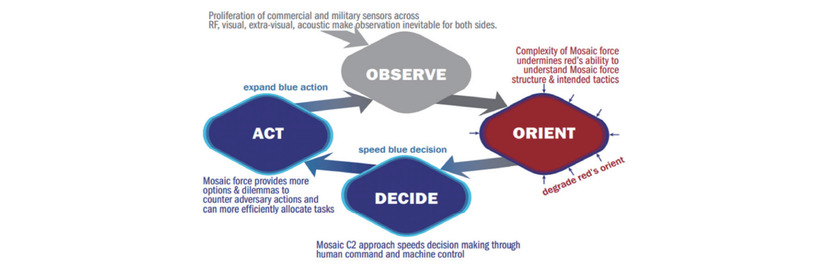

AI가 만들어내는 알고리즘 전쟁은 미군에서 이야기한 모자이크 전쟁(Mosaic Warfare)의 개념과 일정부분 일치한다. 모자이크 전쟁은 공유된 임무 목표 달성을 위해 유무인자산을 운영하여 임무 자율성을 혁신하고, 의사결정의 신속성과 복잡성을 증가하여 적보다 빠르게 대응하고 적은 아군의 상황을 이해하기는 어렵게 만드는 작전 개념이다.

미 DARPA는 이러한 모자이크전을 스포츠 경기로 비유한다. 축구팀 코치가 다양한 선수들을 가지고 상대팀의 전력 평가에 따라 조합하고, 교체로 투입하면서 상대팀의 기량을 소진 시키거나, 결정적 장면을 만들어내는 개념과 유사하다고 설명한다. AI는 편제도 따르지 않고 작전계획을 수립하지 않는다. 실시간으로 가용한 자산과 환경 변수를 계산하여 그 시점에만 유효한 최적의 비대칭 전술을 실시간으로 프로그래밍한다.

의문점과 예상

하지만 전투를 지휘하는 AI에게 다양한 의문점이 존재할 수 있다. 첫째, AI는 인간만큼의 전투에서의 창의력을 발휘할 수 있는가? 이라크 전에서 미군은 IED나 폭탄테러, 러시아-우크라이나 전쟁에서는 드론이 활약하며 전장의 새 지평을 열었다. 예측하지 못하는 수단과 자원을 활용해 적에게 기습을 달성해 원하는 목표를 달성했다. 그리고 이러한 창의성은 인간에게만 있는 것이고, 데이터의 집합인 AI에게는 이러한 능력이 제한된다고 보는 시각이 있다.

결론부터 말하자면 AI는 인간의 방식과는 다른 창의성을 보일 것이다. 인간의 창의성이 무에서 유를 만드는 발명에 가깝다면, AI의 창의성은 수많은 변수 속에 숨겨져 있던 최적의 해답을 찾아내는 발견의 형태로 발현될 것이다.

인간에게 창의성이란, 기존에 부여한 사물의 이름과 용도를 깨고 직관적으로 도약한다. 기존의 상식을 거스르는 저항을 이겨내는 불연속적인 영감으로 이뤄진다. 반면, 알고리즘은 고정관념이나 상식이 없다. AI는 사물을 사회적 맥락이 아닌, 단순한 물리적 제원으로 인식한다.

드론을 예로 들면, AI에게 드론은 양력과 제어력을 가진 비행체고, RPG 탄두는 특정 질량과 폭발 위력을 가진 에너지체다. 목표물 파괴에 필요한 에너지와 에너지 전달 수단의 가성비를 계산한다. 러시아-우크라이나 전쟁에서 탄생한 드론 운용은 재래식 전력이 부족한 상황에서 임시방편으로 때우던 중 탄생한 결과라면, AI에게 있어서 드론은 여기서 물리적으로 결합이 가능하고 승률이 높아서 데이터에 없던 조합이라도 AI에게는 가장 자연스러운 최적해가 된다. 그렇기 때문에 AI에게는 인간이 사물을 기존의 용도로만 사용하려는 심리학적 용인 ‘기능적 고착’이 존재할 가능성이 덜할 수 있다.

IED나 드론 등 급조하였지만 효과가 큰 무기 체계는 대개 기존 기술의 새로운 조합에서 나온다. AI는 가용한 모든 민간/군용 자산을 벡터화(Vectorization)하여 공간에 배치하고, 이후 목표를 달성하기 위한 최단 거리를 계산할 때, 기존에 연결되지 않았던 점들을 이을 수 있다.

예를 들면, 스마트폰 센서 + 세탁기 모터 + 상용 드론 + 급조 폭약식으로 전혀 관련 없는 것들로 연결이 이어질 수도 있다. 인간은 이 넷을 연결하는 데 창의성이 필요하지만, AI에게는 네 변수의 합이 최소 비용으로 최대 파괴력을 내는 수학적 최적점을 찾는 연산으로서 작동할 수 있다. 또한, AI는 기존의 사고방식에서 벗어나는 분포 외(Outof-Distribution) 탐색 능력을 명시적으로 설정할 수 있다. 강화학습의 과정 중 ‘탐색’(Exploration) 단계에서 AI는 무작위적인 시도를 반복한다. 수억 번의 시뮬레이션 중 우연히 이상한 시나리오를 실행하게 되고, 이때 얻어지는 보상이 정규군 무기를 쓸 때보다 크고 비용 대비 효과를 달성한다면, AI는 이를 가장 효율적인 알고리즘으로 사용하게 된다.

둘째, AI는 인간이 지닌 감투정신을 발휘할 수 있을 것인가? 인간이 가지는 가족과 조국을 지키겠다는 의지를 기계적인 언어로 발전시킬 수 있을 것인지에 대한 의문이 들 수 있다. 혹자는 AI에게 인간과 같은 숭고한 희생정신이나 멸사봉공의 자세가 없기에 절체절명의 순간에 부대를 지키기 위해 자신을 던지는 결단을 내리지 못할 것이라 생각할 수 있다. AI은 이를 ‘전역적 최적화’(Global Optimization) 관점에서 수학적으로 달성할 수 있다. AI의 관점에서 희생은 감정의 영역이 아닌 자원 배분과 목적 달성의 영역이다.

AI의 보상 함수가 전역적 승리에 맞춰져 있다면, AI는 승률을 높이기 위해 특정 유닛에게 ‘소멸될 때까지 사수’하라는 명령을 내릴 수 있다. 이는 인간의 멸사봉공보다 더 냉철하고 효과적인 형태로 나타날 수 있다. 6·25전쟁 당시 설마리 전투에서 영국군 글로스터 대대는 압도적인 중공군의 공세를 막아내며 전멸에 가까운 피해를 입었으나 결과적으로 유엔군의 전선 붕괴를 막아냈다. 인간의 관점에서 이는 숭고한 정신력이었지만, AI의 관점에서 이는 국소적 손실을 통한 전역적 이익의 극대화라는 수학적 필연이다. AI는 전장의 모든 유닛을 연결된 데이터 노드로 인식한다. 만약 특정 고지를 사수하는 유닛의 생존 확률이 0%라 할지라도 48시간을 버텨줌으로써 후방의 주력 부대가 재정비될 확률이 1%라도 높아진다면 AI는 지체 없이 해당 유닛을 희생시킨다. AI에게 임무란 감상적인 구호가 아니라, 알고리즘의 최종 목적(Objective Function) 그 자체기 때문이다.

알고리즘 전쟁의 병목

그렇다면 AI를 활용하는 작전에서의 병목현상은 무엇일까? 역설적이게도 전술의 주체였던 인간이다. AI는 전장을 개별 데이터 단위로 쪼개어 보지만, 하위 부대의 병사와 지휘관은 여전히 '부대 단위'의 사고방식에 갇혀 있다. 혹은, AI가 지시한 세밀한 기동을 병사가 체력적, 심리적 한계로 수행하지 못하거나, 지휘관이 자신의 직관과 다르다는 이유로 작전 방향 자체를 수정하는 순간 AI가 계산한 정밀한 승률은 붕괴될 수 있다. 즉, AI 시대의 전술적 패배는 시스템의 오류가 아니라 AI의 고해상도 전술을 따라가지 못하는 인간의 저해상도 실행력에서 기인할 가능성이 크다. 인간이 아닌 한계로는 탐지자산, 명령을 시행하는 부대에 있을 것으로 보인다.

AI의 추론은 데이터로부터 나온다. 소규모 부대까지 AI의 지능을 전달하려면 전장을 실시간으로, 전 영역을 탐지하는 자산과 그것을 연결하는 네트워크가 구축되어야 한다. 한쪽 눈이 가려진 사람이 판단을 잘 내릴 수 없듯, 데이터의 공백은 곧 AI 전술의 맹점으로 이어질 것이다. 생성된 지휘를 실질적으로 행동으로 옮기는 단계에도 병목이 많다. 스타크래프트 게임에서는 유닛 제어를 할 수 있는 게 당연시 되었지만, 실제 전장은 그렇지 않다. AI가 편제를 분해해 개별 전투원 단위로 기동한다면 분산화된 부대에서 AI에게 정보를 제공하고, 지시한 명령을 수행하는 일련의 과정은 광대한 통신 인프라를 요구할 것이다.

또한, 전투지휘 알고리즘이 완벽하게 가동한다 하더라도 이를 물리적으로 이행해야 할 무인 전투체계의 발전이 또다른 병목이 될 수 있다. 일례로 무인체계의 하드웨어 강화학습(Hardware RL)은 보상 함수(Reward Function) 설계에 난관이 있을 수 있다. 예를 들어 무인 로봇이 험지를 주파했을때, 그것이 성공적인 기동이었는지 아니면 내구도를 갉아먹는 무리한 기동이었는지 AI에게 수치로 환산해주는 것은 어렵다. 보상을 너무 단순하게 설정하면 로봇은 목표 도달을 위해 자신의 관절을 부러뜨리는 방식으로 학습하고, 반대로 너무 복잡한 제약 조건을 걸면 학습의 방향을 잃고 아무런 행동도 하지 않는 마비 상태에 빠질 수 있다. 전투지휘를 위한 알고리즘 상에는 고려하지 않았을 현실적인 제약이 물리적인 AI를 구현할 시에는 문제가 될 수 있다. 이외에도 AI 자체의 제한사항도 산적해있다. 이는 연산속도나 하드웨어의 문제가 아니라, 현재 수행하고 있는 학습 알고리즘 자체의 근본적인 한계에 기인한다.

첫번째는 파라미터 폭발과 학습 수렴의 불확실성이다. 전쟁은 바둑이나 스타크래프트보다 수천 배 더 많은 변수가 존재하는 고차원적이고 비정상성을 지닌 환경이다. 강화학습의 에이전트가 최적의 정책으로 수렴하기 위해서는 수억 번의 시행착오가 필요하다. 하지만 전장은 실시간으로 지형이 변하고, 적의 교리가 바뀐다면 데이터에 노이즈가 섞인다. 이 과정에서 학습의 파라미터가 최적해를 찾지 못하고 발산하거나, 국소적인 최적해에 갇혀버릴 수 있다. 이 경우 AI는 결정의 순간에 이해할 수 없거나, 멍청한 수를 반복할 수 있다. 또한, 학습은 군사적인 목표나 최종상태라는 보상을 얻는 과정이다. 하지만 그 보상이 작전의 맨 끝에만 존재하는 희소한 보상(Spare Reward) 상황에 놓여 있다. 이는 작전 중간의 사소한 행동들이 승리에 기여했는지 판단하기 어렵다는 신용 할당(Credit Assignment) 문제를 낳기 때문에, AI가 학습의 갈피를 잡지 못하는 상황이 발생한다.

둘째는 연속성과 국면 전환의 문제점이다. 전쟁은 단발성 교전이 아닌, 여러 국면이 얽혀 있다. 현재의 AI는 특정 상황인 교전에서의 최적화에는 능하나, 전체 작전의 맥락을 유지하며 국면을 전환하는 능력에는 제한이 있다. 예를 들어 침투 단계에서 교전 단계로 전환해야 할 시점을 결정하는 것은 고도의 전략적 판단이다. AI가 침투 단계의 보상 함수에만 매몰되어 있다면, 근접 전투가 필요한 타이밍에도 소극적 기동을 고집하는 전술적 고립에 빠질 수 있다. 또한, 인간 지휘관은 작전을 수립할 때, 현재 싸우고 있는 현행작전뿐만 아니라, 목표 달성도에 따라 다음 국면인 장차작전과 장차계획을 수립하고, 이를 고려한다. 하지만 현재의 강화학습 모델에 특화되어 있는 AI는 당면한 국면의 보상(승리)을 극대화하는 데 편향되어 있다. 지금 상황이라면 AI는 최초 국면에서의 압도적 승리를 위해 가용한 모든 자원을 소모해 버림으로써, 차후 국면에 활용할 전력을 남기지 않아 나중에 위태로워지는 국부 최적화(Local Optimization) 오류를 범할 수 있다.

이를 해결하기 위해 계층형 강화학습(Hierarchical RL)이라는 방법론이 도입되기도 한다. 이는 전체적인 전략을 담당하는 상위 에이전트와 세부적인 전술을 담당하는 하위 에이전트를 분리한다. 상위 AI가 작전 국면의 전환을 결정하거나 성과를 판단하면, 하위 AI는 그 지침 안에서 실시간 전술을 최적화한다. 이를 통해 장기 작전의 연속성을 확보하고 학습 수렴 속도를 어느 정도 높일 수는 있으나6, 하위 목표의 정확도와 양에 따라 학습의 질이 결정되고, 상하위 계층간의 연계성을 확보해야 하는 새로운 문제점이 생긴다.

셋째는 학습 데이터의 희소성이다. 인터넷에 널린 텍스트, 이미지, 비디오와는 달리, 현대전의 실전 데이터는 극도로 제한적이며 비정형적이기 때문이다. 이는 Physical AI를 다루는 로보틱스 분야가 직면했던 문제와 일치한다. 로봇이 현실 세계의 물리 법칙을 배우기 위해 수만 번 넘어지며 고철이 될 수 없듯, AI의 학습을 위해 실제 전쟁을 수만 번 일으킬 수는 없다. NVIDIA는 로보틱스 분야의 현실 데이터를 대체하기 위해 디지털 세계에 물리 법칙을 구현한 코스모스(COSMOS)나 옴니버스(Omniverse)와 같은 가상 훈련장을 구축했다. 미래의 군사 AI 역시 현실의 전장이 아닌, 디지털트윈으로 구축된 가상의 시공간에서 모의전을 치르며 합성 데이터(Synthetic Data)를 생산할 가능성이 높다.

향후 예상 및 발전방안

향후 예상 및 발전방안을 제시해 보고자 한다.

첫째로, 인간 지휘관은 AI의 비선형적 논리를 받아들이도록 재교육되어야 한다. 인간 지휘관의 역할은 그 논리를 파헤치는 것이 아니라 시스템이 제 기능을 발휘하도록 인지적 병목을 해제하는 것에 있다. 설명 가능한 AI(x-AI)처럼 AI가 자신의 판단을 인간에게 설득시키는 것이 아니라, AI가 어떤 판단을 했는지 인간이 유추하고, 이를 명확하게 인지한 상태에서 결정을 내릴 수 있는 새로운 교육훈련 방안이 필요해질 것이다. 과거 조종사들이 자신의 평형감각 대신 비행기 계기판을 믿는 훈련을 했듯이, 미래 지휘관은 자신의 직관(교리) 대신 AI의 데이터 결과값을 믿는 데이터 신뢰 훈련이 필요할 것이다.

둘째로, AI의 전술적 판단을 물리적으로 뒷받침해야 할 군수 지원 분야가 병목이 될 가능성이 높다. AI가 구사하는 모자이크 전쟁의 핵심은 부대를 잘게 쪼개고, 상황에 따라 이질적인 전력들을 섞는 것인데, 이는 군수지원의 관점에서는 말 그대로 악몽이다. 기존의 군수지원는 상급부대의 고정된 거점을 위주로 분배하는 방식으로 이뤄졌다. 그러나 AI는 전술적 이득과 생존성을 위해 병력을 사방으로 흩뿌려 놓는다. 이는 산발적으로 흩어진 수천 개의 개별 전투 노드에게 일일이 보급을 해줘야 함을 의미한다. 또한, AI 지휘관은 부대 편제를 해체하고 재조립하기 때문에 보급의 유형이 완전히 뒤섞여 버린다. 결국 AI가 아무리 환상적인 전술을 내놓는다 해도, 이것을 유지시킬 수 있는 군수지원능력이 뒷받침되지 않는다면 컴퓨터 안에서만 유효한 작전이 될 것이다.

셋째로, 군사력을 과시하는 수단(비대칭무기, WMD)의 역할이 강해질 수 있다. 전투 자체는 인간이 아닌 AI 알고리즘에 의해 수행되지만, 그 전투 및 전쟁 자체를 결정하는 인간에게 영향을 주는 억제나 과시 수단이 되는 무기체계의 중요성이 상승할 것이다. 이는 전쟁의 기술적 진보가 국가 간의 경제적 불평등과 맞물려 발생할 것으로 예상된다. 앞서 언급한 전투지휘 분야의 AI를 구축하고 유지하는 것은 천문학적인 비용과 데이터 인프라를 요구한다. 미국이나 중국과 같은 소수의 군사 강국을 제외한 대다수의 국가는 이러한 고비용 구조를 감당하기 어려울 것이다. 따라서 미래의 전장은 AI가 지휘하는 소수의 강대국과 인간 직관에 의존하는 국가들이 혼재된 불균형한 형태를 띌 것이다.

이 알고리즘 전쟁에서 소외된 국가나 비국가 행위자는 재래식 전투로는 AI 군대를 절대 이길 수 없음을 인지하게 된다. 이들은 테러리스트처럼 민간인이나 인프라에 직접적인 타격을 가할 수 있는 수단을 찾을 것이다. “전투에서 AI가 승리하더라도 국민들은 안전하지 못할 것”이라는 메시지를 통해 기술적 열세를 공포로 상쇄하려고 시도할 것이다.

따라서 AI 강국 입장에서도 단순히 전투를 잘하는 알고리즘 만으로 안보를 장담할 수 없다. 전투 자체는 기계가 수행하더라도, 전쟁을 시작하고 끝내는 결정은 여전히 인간이 내리기 때문이다. 적대 세력의 인간 지도자가 AI의 성능 차이를 무시하고 비대칭 무기로 벼랑끝 전술을 사용하지 못하도록 억제력과 과시 수단을 병렬적으로 확보하는 것 또한 필수적이다.

마지막으로, AI의 판단력을 적보다 우월하게 유지하기 위한 ‘AI 전자전’ 혹은 ‘데이터 전자전’ 개념을 고려해야 한다. 마치 핵무기 보유 경쟁처럼 전세계 국가들은 앞다투어 고성능의 AI를 적용할 것인데, AI가 제대로 된 판단을 하기 위해서는 무엇보다 정확한 데이터 확보가 필요하고, 반대로 적 AI가 잘못된 데이터를 확보하면 아무리 똑똑해도 실수를 유발하여 약점을 노출할 것이다. 이를 반영하여 아군 AI에게 정확한 전장 데이터를 입력하기 위해 정찰자원을 확보하고, 아군 자산의 현재 상태를 정확하고 신뢰성있는 데이터로 AI에 제공하는 ‘AI 전자 방어’ 개념과, 적 AI에게 혼란을 유발하고 적 자산에 대한 정보에 오류를 일으키도록 기만, 탈취, 교란, 가짜 데이터 주입을 하는 ‘AI 전자 공격’ 개념에 대한 연구를 진행해야 한다.

맺는 말

지금까지 우리는 ‘GenAI.mil’의 도입을 시작으로, AI이 단순한 참모를 넘어 ‘가상 지휘관’(Virtual Commander)으로 진화하는 기술적 배경과 미래 전장의 양상을 살펴보았다.

딥러닝과 강화학습, 다개체 강화학습으로 무장한 AI는 인간의 직관을 뛰어넘는 확률적 최적해를 도출할 것이며, 이는 필연적으로 편제의 해체와 모자이크 전쟁 개념을 구현할 것이다. AI는 드론과 미사일, 그리고 인간 병사를 데이터 노드로 환원시켜 우리가 창의성이나 감투정신이라 불렀던 영역을 수학적 발견으로 대체해 나갈 것이다.

그러나 알고리즘 전쟁의 승리가 곧바로 보장되는 것은 아니다. 우리는 역설적이게도 가장 첨단의 두뇌가 가장 현실적인 육체인 하드웨어와 군수지원 한계에 부딪히는 병목현상을 목격하게 될 것이다. 또한 AI의 기계적 추론을 신뢰해야 하는 지휘관의 인지적 저항 또한, 우리가 대처하거나 포용해야할 과제일 것이다. 이러한 제한사항을 볼 때 미래 전쟁의 승패는 ‘누가 더 똑똑한 AI를 가졌는가’가 아니라, ‘누가 AI가 그려낸 승리를 현실에 얼마나 잘 구현하는가’에 달려 있을것이다.

클라우제비츠는 ‘전장의 안개’(Fog of War)를 걷어내는 것이 지휘관의 덕목이라 했다. 다가올 미래에 우리 앞에 놓인 것은 AI의 ‘알고리즘의 안개’(Fog of Algorithm)일지도 모른다. 이 안개 속에서 길을 잃지 않으려면 우리는 기계를 이해하려는 노력과 동시에, 기계가 결코 대체할 수 없는 인간의 역할이 무엇인지에 대한 고민을 멈추지 말아야 할 것이다.

“미래의 문맹은 글을 못 읽는 사람이 아니라, AI와 협력하는 법을 모르는 사람이 될 것이다”라는 말처럼, 군사적 문맹의 기준 또한 바뀔 것이다. 단순히 교범을 알고 모르는 것에서 끝나지 않고, 알고리즘을 지휘하고 때로는 알고리즘에 지휘받을 준비가 된 자만이 미래 전장의 생존자가 될 것이다.

「참고문헌」

[1] Volodymyr Mnih et al. “Playing atari with deep reinforcement learning”, 2013, https://arxiv.org/pdf/1312.05602

[2] John Schulman et al. “Proximal Policy Optimization Algorithms”, 2017, https://arxiv.org/abs/1707.06347

[3] Tuomas Haarnoja et al. “Soft actor-critic algorithms and applications”, 2018, https://arxiv.org/pdf/1812.05905

[4] Lili Chen et al. “Decision Transformer : Reinforcement Learning via Sequence Modeling”, 2021, Advances in Neural Information Processing Systems 34 (NeurIPS 2021.)

[5] Lucian Busoniu et al. “A Comprehensive Survey of Multiagent Reinforcement Learning”, 2008.

[6] Shubham Pateria et al. “Hierarchical Reinforcement Learning : A Comprehensive Survey”, 2021, ACM Computing Surveys

[7] CSBA White Paper, “Mosaic Warfare”, 2019.