724 읽음

AI發 ‘메모리 블랙홀’, 한국 기업이 웃는 이유

시사위크

시사위크 1

1

바야흐로 ‘인공지능(AI) 반도체 춘추전국시대’가 시작됐다. 엔비디아(NVIDA)가 그간 독점했던 AI반도체 시장에 구글, 마이크로소프트, 아마존 등 굵직한 글로벌 빅테크 기업들이 참전하기 시작했다. AI반도체 산업의 핵심은 ‘메모리 반도체’다. 때문에 전문가들은 AI 생태계 확장 가속화가 이뤄짐에 따라 주요 IT기업들이 메모리 반도체를 대량으로 사재기하는 ‘메모리 블랙홀’이 발생할 것으로 보고 있다.

◇ 메모리 집어삼키는 글로벌 AI빅테크… ‘물량이 없다’

11일 반도체 업계에 따르면 시장 내 메모리 공급 부족이 심화, 스마트폰과 노트북에 사용될 재고도 부족한 것으로 확인됐다. 구글, 아마존, 마이크로소프트 등 글로벌 AI기업들을 중심으로 자체 설계 AI칩(ASIC) 사업 확장에 속도가 붙기 시작하면서다.

실제로 2일 대만시장조사업체 ‘트렌트포스(Trendforce)’는 보고서를 통해 “메모리 가격상승으로 인해 소비자 가전 제품의 원자재 비용이 크게 증가했다”며 “이로 인해 스마트폰과 노트북의 내년도 출하량 전망치를 하향 조정하고 게임 콘솔 역시 기존 대비 4.4% 감소할 것으로 하향 조정했다”고 설명했다.

글로벌 AI기업들이 자체 ASIC에 나서는 것은 ‘엔비디아 의존도’를 낮추기 위함으로 풀이된다. 현재 AI칩 시장 내 엔비디아의 GPU가 차지하는 비중은 약 80%으로 추정된다. 때문에 엔비디아의 GPU는 ‘부르는 게 값’이다. 뿐만 아니라 엔비디아의 GPU모델 없이는 사실상 AI개발속도가 늦춰지는 실정이다.

트렌드포스는 “내년 ASIC 성장률이 GPU 성장률을 앞지를 수 있고, 이는 엔비디아에 압박을 가할 수 있다”며 “경쟁의 초점은 이제 칩 성능에서 인터커넥트, 스위치, 소프트웨어 및 생태계로 옮겨갔다”고 설명했다.

이어 “내년 안 AI시장의 중요한 전환점에 서 있다”며 “클라우드 서비스 제공업체(CSP)의 자체 개발 ASIC는 전년 대비 44.6% 성장해, 동 기간 GPU의 성장률인 16.1%를 크게 앞지를 것”이라고 분석했다.

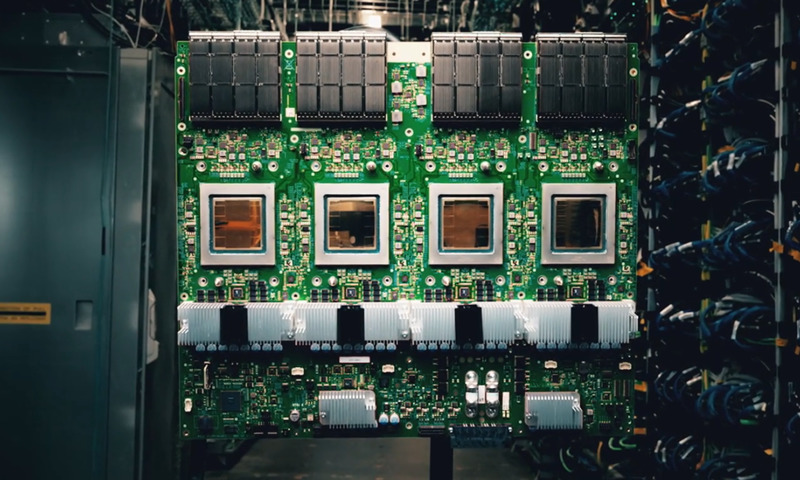

이에 글로벌 AI기업들의 자체 ASIC 개발 속도는 빨라지고 있다. 그 중심에는 ‘구글’이 있다. 구글은 자체 개발한 ‘텐서처리장치(TPU)’ 모델의 지속적 성능 향상을 진행 중이다.

TPU는 지난 2016년 1세대 모델이 처음 공개된 당시에도 일반 GPU모델보다 약 15~30배 빠른 연산속도를 자랑했다. 특히 합성곱 신경망(CNN), 순환신경망(RNN) 등 고성능 AI머신러닝 학습 시엔 30~80배 우수하다는 게 구글 측 설명이다.

실제로 최근 구글은 7세대 TPU ‘아이언우드’로 학습시킨 AI모델 ‘제미나이3 딥싱크’가 ‘인류 최후의 시험(Humanity's Last Exam, HLE)’에서 41%를 기록, 오픈AI의 ‘GPT-5.1(26.5%)’과 xAI ‘그록4(25.4%)’를 압도했다고 밝혔다. HLE는 광범위한 주제에 걸쳐 2,500개의 질문으로 구성된 언어 모델 벤치마크다. AI지능수준을 평가하기 위한 대표적 시험이다.

이처럼 TPU가 GPU의연산 능력을 압도힌 비결은 ‘물리적 구조’차이다. GPU는 데이터 연산을 담당하는 수리논리연산장치(ALU)와 사이에 ‘데이터패스(Data path)’라고 하는 통로가 연결돼 있다. 때문에 GPU의 연산 과정은 ‘메모리에서 데이터 전송→GPU 연산→다시 메모리로 데이터 전송→AI가동’ 단계로 진행된다.

반면 TPU는 이 연산 과정에 필요한 수리 논리 연산 장치(ALU) 2개가 딱 붙어있다. 때문에 연산 과정에서 메모리에 데이터를 적재·로딩하는 과정이 없다. 이를 통해 훨씬 빠른 연산능력 구현이 가능하다. 국내선 LG AI리서치의 ‘엑사원’ 등 초거대 AI모델에 TPU가 사용된 것으로 알려졌다.

김동원 KB리서치 본부장은 10일 리포트에서 “AI 인프라 또한 엔비디아 중심에서 구글, 아마존, 마이크로소프트, 메타 등으로 본격 다변화될 전망”이라며 “이 가운데 구글 TPU 출하량은 2025년 170만개, 2026년 260만개, 2028년 850만개로 3년간 약 5배 확대가 예상된다”고 전망했다.

AI칩 기업들의 경쟁은 더욱 치열해질 전망에 함박웃음을 짓는 곳들이 있다. 바로 국내 반도체 업계다. 전문가들은 AI칩 시장 경쟁으로 발생한 메모리 블랙홀이 국내 삼성전자와 SK하이닉스 등 국내 주요 메모리 반도체 생산 기업들에겐 ‘실적 축제’가 될 것으로 기대하고 있다.

가장 기대되는 사업 분야는 ‘고대역폭 메모리(HBM)’다. AI칩에는 삼성전자와 SK하이닉스에서 생산되는 최신형 HBM이 필수적으로 탑재된다. 때문에 AI산업이 급성장한 이후 HBM시장도 폭발적 성장을 보여주고 있다.

10일 KB리서치는 보고서를 통해 “추론 AI시장의 팽창은 자체 AI칩 생산 확산과 AI메모리 반도체 수요를 견인하는 핵심 요인으로 작용할 전망”이라고 분석했다. 그러면서 내년 AI칩당 HBM 평균 탑재량은 HBM3E, HBM4 탑재로 전년 대비 약 50% 증가할 것으로 예상했다.

또한 해외 HBM 경쟁사인 ‘마이크론’의 생산능력이 부족하다는 점도 삼성전자와 SK하이닉스에겐 긍정적 요소다. 업계에 따르면 마이크론의 HBM 생산능력은 국내 기업 대비 3분의 1 수준으로 추정된다. 때문에 글로벌 AI칩용 HBM 공급망 시장을 국내 기업이 90% 이상의 점유율로 차지할 수 있다는 게 업계의 전망이다.

김동원 KB리서치 본부장은 “삼성전자와 SK하이닉스는 메모리 시장에서 향후 최소 2년간 공급이 수요를 결정하는 절대 공급자 우위 국면이 지속될 것”이라며 “내년 삼성전자와 SK하이닉스의 합산 영업이익은 올해 대비 109% 증가한 178조원으로 추정된다”고 밝혔다.

이어 “AI 대확장기의 최종 승자는 삼성전자, SK하이닉스가 될 것으로 기대된다”며 “특히 삼성전자는 구글 TPU용 HBM4 품질 테스트를 통과해 2026년 브로드컴 HBM 공급 물량은 전년대비 3배 증가할 것으로 예상된다”고 전했다.